Las piedras angulares de las redes sociales del cártel de las grandes tecnologías, Twitter y Facebook, se convirtieron en la vía principal en la que los ciudadanos, los gobiernos y las empresas se comunican entre sí, transmiten advertencias e instrucciones y hacen publicidad. Hoy en día, a medida que estas plataformas se han vuelto plagadas de censura y una narrativa densa de una sola voz, izquierdista y del establishment, ¿qué pasa si las cuentas que ves, los comentarios que publican e incluso las imágenes de perfil que usan, en realidad solo son generadas por ¿inteligencia artificial?

Ese es exactamente el caso cuando se trata de cuentas pro-China del Partido Comunista en Twitter y Facebook, según un informe del 4 de agosto del Centro para la Resiliencia de la Información (CIR) titulado Análisis de la red de propaganda pro-China dirigida a narrativas internacionales.

El informe de 80 páginas, compuesto principalmente de evidencia pictórica y ejemplos del mundo real, debe considerarse una lectura obligada para cualquier usuario de redes sociales, especialmente para aquellos preocupados por la veracidad e integridad de los mensajes que leen y las respuestas que reciben en las plataformas de redes sociales.

La ONG Centre of Information Resilience (CIR) dice que han descubierto un «intento coordinado, utilizando una combinación de cuentas de redes sociales falsas, reales y robadas, para distorsionar las percepciones internacionales sobre temas importantes, elevar la reputación de China entre sus partidarios y desacreditar las afirmaciones críticas del gobierno chino».

Descubrieron que la campaña del bot de inteligencia artificial (IA) opera tanto en inglés como en chino y buscaron influir en la opinión pública haciéndose pasar por usuarios orgánicos y reales en temas como el control de armas, la justicia racial, COVID-19 y el genocidio de Xinjiang.

Success

You are now signed up for our newsletter

Success

Check your email to complete sign up

Se descubrió que la botnet de Twitter del Partido comunista chino (PCCh) usaba cuentas que se hacían pasar por personas mediante el uso de imágenes de perfil generadas por aprendizaje automático a través de StyleGAN. CIR explicó la tecnología de la siguiente manera: “StyleGAN, abreviatura de Style Generative Adversarial Networks, es un tipo de marco de aprendizaje automático, donde una técnica entrenada en un conjunto de datos es capaz de generar nuevos datos con las mismas estadísticas que el conjunto de datos. Para las redes StyleGAN, la técnica permite crear caras nuevas que no existen en la vida real».

Algunos de los mayores indicios de que la botnet estaba usando imágenes de perfil sintéticas fue el sutil desenfoque de los rasgos faciales, los lugares donde las cabezas se encuentran con el fondo, la alineación de los dientes o donde las gafas se encuentran con las caras. Pero la mayor señal de alerta fue que los ojos de cada foto estaban todos en el mismo eje horizontal, lo que los investigadores demostraron ser definitivamente consistente en docenas de cuentas.

Señalaron que la botnet también utilizaba cuentas con «imágenes de apariencia más auténtica», incluidas imágenes de anime y cuentas que claramente alguna vez fueron propiedad de una persona, pero que habían sido «reutilizadas» para servir como una herramienta de propaganda, probablemente a través de una cuenta comprada o una contraseña comprometida.

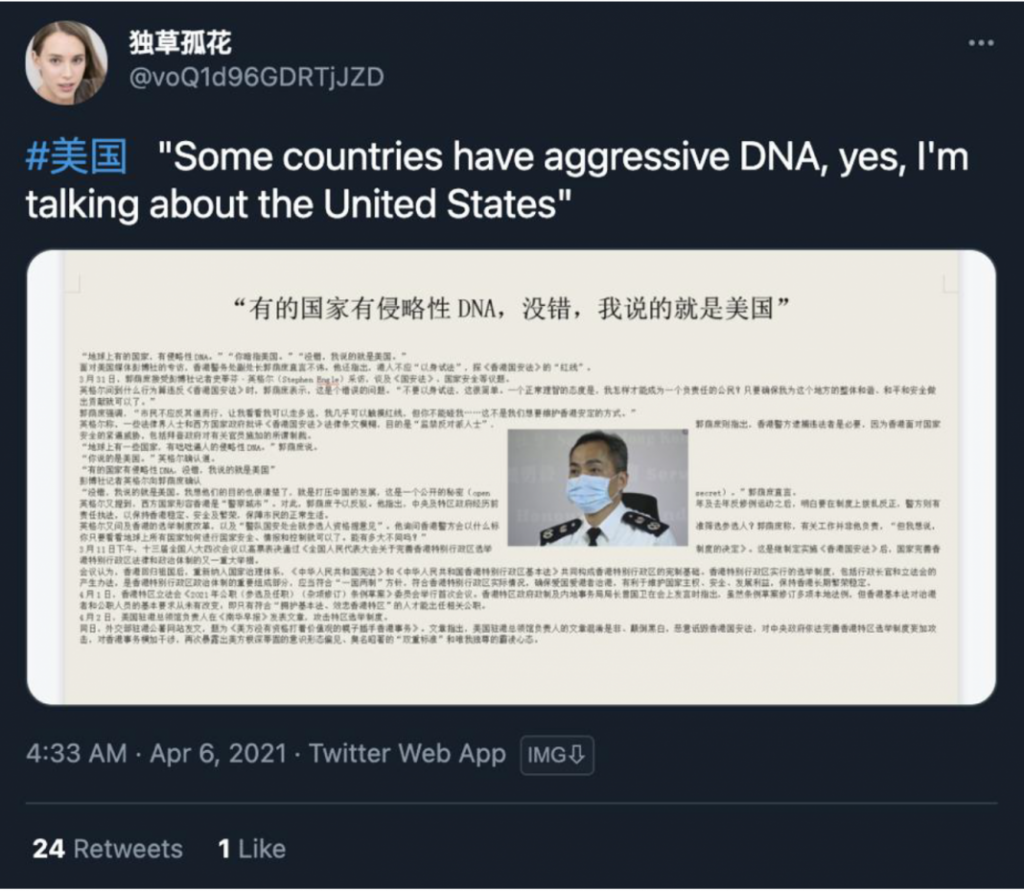

Tenga en cuenta el identificador en chino, el nombre de cuenta alfanumérico, el uso de una imagen de perfil generada por StyleGAN de un joven caucásico y una publicación que consta de una narrativa de propaganda en inglés y una foto con mucho texto en chino.

(Imagen: informe del Centro para la resiliencia de la información)

CIR señaló que su investigación descubrió que las redes de bots del PCCh todavía usaban características similares a las encontradas en los informes entre 2019 y 2021 de Graphika, el Instituto Australiano de Política Estratégica, Stanford y otros, como el uso de imágenes de estilo 4Chan con mucho texto, un sentimiento pro-China y anti-oeste, y patrones que surgen tanto de cuentas reutilizadas como de una división del trabajo entre bots para publicar y compartir.

El equipo extrajo datos de la API de Twitter basándose en tres hashtags para recopilar inteligencia para su análisis en el transcurso de un mes:

- # 香港 (Hong Kong);

- # 美国 (Estados Unidos); y

- # 郭文贵 (Guo Wengui).

Luego, el equipo limpió y procesó los datos antes de usar la plataforma de visualización de datos Gephi para compilar sus hallazgos. Para discernir entre cuentas que pueden ser bots y cuentas que pueden ser humanos reales, CIR analizó factores como si tenía un nombre de usuario único, métricas de cuenta como seguidores y seguimiento, antigüedad de la cuenta y proporción de retweet, entre otros.

Por ejemplo, varias docenas de bots que componían una red a menudo tomaban instrucciones de una cuenta con el identificador @ corrinehartma10 y llevaban casi exclusivamente nombres alfanuméricos como @hollyca07911706, @ellafit29332445 y @tonyabe15414870.

El equipo encontró un patrón casi idéntico de publicación de imágenes basadas en texto, uso de hashtag, nomenclatura de cuenta, fototipo de perfil y respuestas basadas en narrativas de propaganda tanto en Facebook como en la sección de comentarios de YouTube.

Un enfoque muy utilizado por los creadores de la botnet fue que un tweet de una cuenta dedicada a la publicación fuera retuiteado por una variedad de cuentas con cero seguidores con nombres arquetípicos, fotos e historia similares, para garantizar que la propaganda ganara fuerza en el algoritmo de Twitter y así pueda tener la oportunidad de llegar a los ojos de usuarios humanos reales o volverse viral.

La investigación encontró que sobre el tema de la violencia armada en Estados Unidos y el genocidio de musulmanes uigures en Xinjiang, la botnet siguió el ejemplo de los empleados de los medios de comunicación estatales del PCCh y las cuentas de los portavoces oficiales del Partido.

El informe da el ejemplo específico del genocidio de Xinjiang de bots que publican contenido de propaganda con el objetivo de negar y deslegitimar la persecución de los musulmanes uigures, similar al retuiteado por el portavoz del Ministerio de Relaciones Exteriores, Zhao Lijian y Hu Xijin, el editor en jefe del medio portavoz del Partido Comunista, el Global Times, .

El patrón se repitió a través de otros temas como el de Black Lives Matter y la justicia racial, la reciente crisis del COVID-19 en India, la teoría de la fuga del laboratorio de Wuhan y el movimiento democrático de Hong Kong.